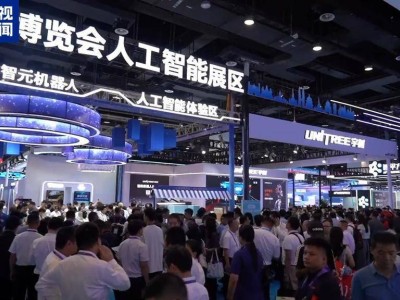

在2025云棲大會開幕式上,阿里巴巴宣布推出七款全新通義系列模型,進一步鞏固其在人工智能領域的領先地位。此次發布的模型涵蓋編程、多模態處理、視頻生成等多個領域,標志著阿里在AI技術布局上的又一次重大突破。

作為本次發布的核心產品,Qwen3-MAX萬億參數大模型在編程與工具調用能力方面表現突出。該模型預訓練數據量達36T tokens,包含Instruct和Thinking兩個版本。Instruct版本在SWE-Bench Verified測試中斬獲69.6分,位列全球第一梯隊;Thinking版本在AIME25評測中得分81.6,顯著高于前代模型。這兩個版本分別適用于即時交互任務和高階邏輯推演場景,展現了強大的技術實力。

另一款重磅產品Qwen3-Omni原生全模態大模型支持19種語言及方言輸入、10種語言輸出。該模型采用Thinker-Talker MoE架構,可處理長達30分鐘的會議錄音或播客并精準輸出紀要。在音頻識別、語音生成等任務上全面超越前代模型,閉源版提供17種擬人音色,每種音色支持10語種自然表達,展現了卓越的多語言處理能力。

在視頻處理領域,Qwen3-VL視覺理解模型實現重大突破。該模型支持2小時視頻精確定位,OCR語言從19種擴展至32種,生僻字、古籍、傾斜文本識別率顯著提升。其視覺智能體在OS World等評測中達世界頂尖水平,Thinking版本在MathVista、MathVision等STEM推理評測中達SOTA水平,為視頻內容理解提供了強大技術支持。

編程領域迎來Qwen3-Coder智能編程模型,該模型支持多模態輸入,可上傳截圖+自然語言指令生成代碼。新版本在SWE-Bench Verified上得分達70.3,TerminalBench與SecCodeBench也顯著上漲。支持256K上下文,可一次性理解并修復整個項目級代碼庫,推理速度更快、Token消耗更少、安全性更高,為開發者提供了高效的編程工具。

視頻生成領域,Wan2.5-Preview首次原生支持音畫同步,可生成10秒長視頻,時長提升1倍,最高支持1080P 24fps畫質。該模型在復雜指令遵循、圖生視頻保ID優化、通用音頻驅動等方面實現升級,為視頻創作提供了更強大的技術支持。

企業級應用方面,全新發布的通義百聆整合了Fun-ASR語音識別大模型與Fun-CosyVoice語音合成大模型。Fun-ASR通過首創的Context增強架構,將幻覺率從78.5%降至10.7%,支持熱詞動態注入與跨語種語音克隆。Fun-CosyVoice采用創新性語音解耦訓練方法,支持跨語種語音克隆,5分鐘即可完成配置,為企業語音應用提供了可靠解決方案。

阿里巴巴集團CEO吳泳銘在會上系統闡述了通往超級人工智能(ASI)的三階段演進路線。他指出,AI發展將經歷"智能涌現"、"自主行動"和"自我迭代"三個階段,最終實現能自我迭代、全面超越人類的ASI。吳泳銘強調,大模型將成為下一代的操作系統,超級AI云是下一代的計算機,未來全世界可能只會有5-6個超級云計算平臺。

為實現這一愿景,阿里巴巴正在積極推進三年3800億的AI基礎設施建設計劃。阿里云智能集團首席技術官周靖人介紹,阿里云百煉平臺在Agent智能體開發與AI基礎設施上實現了功能改進和升級,提供低代碼開發方式和基于Agentscope的Agent開發框架,支持多種開發方式,全面提升開發效率。

在AI基礎設施方面,阿里推出磐久AI Infra2.0 128超節點服務器,單柜最高功率達350千瓦,系統供電可用性高達99.9999%。同時推出高性能網絡HPN8.0,支持跨數據中心連接,實現資源調度。分布式存儲方面,CPFS單客戶端存儲量達每秒40GB,相比傳統方案提升60%,為AI應用提供了強大的基礎設施支持。