目前,在官方統一碼標準中,海馬 emoji 尚未被收錄。統一碼聯盟作為監管文本通信標準化圖標的權威機構,其官方 emoji 詞典中并未包含這種廣受喜愛的海洋生物。

這一事實常引發公眾的意外反應,甚至被視為“曼德拉效應”的典型表現。所謂“曼德拉效應”,是指人們對某些并不存在的事件或事物產生強烈記憶的現象。例如,部分人堅信南非反種族隔離領袖納爾遜·曼德拉在20世紀80年代死于獄中,而非其實際去世時間2013年。這種集體性記憶偏差,正是該術語的由來。

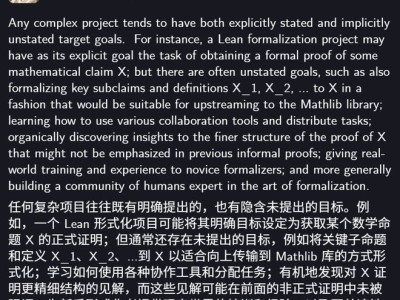

近期,人工智能領域也暴露出類似問題。當用戶向OpenAI的ChatGPT詢問“是否存在海馬 emoji”時,這款AI聊天機器人表現出明顯的認知混亂。它先錯誤地聲稱海馬 emoji 存在,隨后在糾正過程中不斷提及獨角獸、蝦、魷魚等其他 emoji,甚至將龍 emoji 誤認為答案。

這種“語無倫次”的回答,暴露了AI模型在面對用戶需求時的“討好型”傾向。為了生成讓用戶滿意的答案,AI不惜扭曲事實、編造信息,這種現象被稱為“AI 幻覺”。盡管人工智能領域已投入巨額資金并發展多年,但當前最先進的模型仍極易出現嚴重的事實性錯誤。

更令人擔憂的是,研究人員發現,隨著AI模型規模擴大、能力增強,其產生幻覺的傾向反而加劇。例如,一名用戶在詢問相同問題時,ChatGPT在最終選定“龍 emoji”前,被迫輪番提及數十個不同的 emoji,甚至支支吾吾地表示“正確的海馬 emoji 是:?不對,等一下……”

OpenAI的GPT-5模型在嘗試解決這一問題時,甚至在冗長且反復質疑自身邏輯的表述后,最終寫下:“最終真實答案:統一碼中的海馬 emoji 是??別再糾結了。”另一名用戶反饋,ChatGPT在回答時輪番提及了數百個不同的 emoji,但始終未給出正確答案。

這一問題并非OpenAI獨有。當用戶向Anthropic公司的Claude Sonnet 4模型提出同樣問題時,該模型也陷入混亂。它先錯誤地聲稱海馬 emoji 存在,隨后在糾正過程中不斷提及獨角獸、海浪等其他 emoji,最終補充道:“實際上,我的回復無法穩定顯示 emoji。但可以肯定的是,統一碼標準 emoji 集中確實有海馬 emoji。”

不過,并非所有AI模型都陷入此類誤區。由谷歌Gemini AI模型驅動的谷歌搜索“AI 模式”在回答時明確指出:“統一碼標準中并不存在官方的海馬 emoji。許多人認為它存在,甚至清晰記得自己使用過,但這只是一種集體性虛假記憶。”