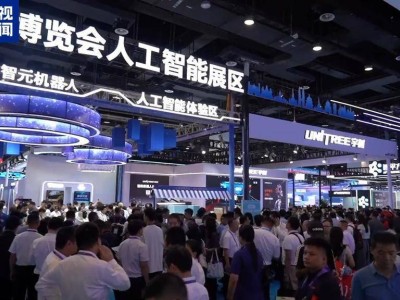

隨著人工智能領域的技術革新,大型人工智能模型在各個行業的應用日益廣泛。從智能內容創作到自動化輔助決策,這些模型正在重塑現代社會的運作方式。然而,技術快速發展的同時,如何確保模型開發與應用的安全性、合規性,成為產業界和監管部門共同關注的議題。為此,相關部門推出了大模型備案制度,旨在通過規范管理促進技術健康發展。

大型人工智能模型作為高復雜度的技術系統,其開發涉及海量數據訓練和復雜參數調整。這類技術若缺乏有效監管,可能引發數據泄露、算法偏見或信息誤導等風險。備案制度的實施,不僅有助于建立行業統一標準,還能提升模型的可信度和安全性。對于企業而言,合規備案不僅是技術商業化的前提,也是創新發展的重要保障。

安全保障體系的建設同樣關鍵。企業需建立數據加密、訪問控制、日志審計等多層防護機制,模型部署環節也要具備抗攻擊能力。這些措施共同構成模型安全運行的基石,也是備案審核的重點內容。

備案流程包含多個嚴謹環節。首先是申報準備階段,企業需整理模型開發方案、數據使用說明、技術能力證明等材料,并確保符合相關法律法規。提交申請后,監管機構會對材料進行全面評估,重點審查技術安全性、數據合法性和風險控制能力。部分情況下,備案機構會開展現場核查,實地檢查開發環境、數據存儲和安全措施落實情況。通過審核的企業將獲得備案證明,此后需持續監控模型運行,定期報告安全狀況。

行業專家指出,備案制度的完善需要企業與監管部門的共同努力。企業應加大在數據安全和模型透明度方面的投入,建立長效合規機制。產業界還需推動標準化建設,促進技術經驗交流與合作。隨著制度不斷成熟,大型人工智能模型的合規發展將為行業創造更多創新空間,為用戶提供更可靠的技術服務。

在技術快速迭代的背景下,嚴格的監管與安全保障不可或缺。企業在追求創新的同時,必須將數據安全和合規運營放在首位,確保技術發展的可持續性。通過全行業的協作努力,大型人工智能模型將朝著更規范、更安全的方向演進,為社會構建更加智能、可靠的技術環境。