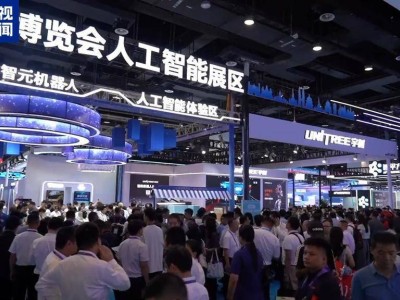

在人工智能技術(shù)加速滲透各領(lǐng)域的當(dāng)下,AI智能體作為承載復(fù)雜任務(wù)的核心載體,其安全性問題正引發(fā)社會(huì)高度關(guān)注。9月16日國家網(wǎng)絡(luò)安全宣傳周期間,中國電信聯(lián)合公安部第三研究所、華為、螞蟻集團(tuán)、清華大學(xué)、上海交通大學(xué)及《信息安全研究》雜志社等十余家單位,共同發(fā)布了行業(yè)首個(gè)《AI智能體安全治理》白皮書,為構(gòu)建智能體安全生態(tài)提供系統(tǒng)性解決方案。

該白皮書深度剖析了AI智能體在環(huán)境感知、決策規(guī)劃、學(xué)習(xí)記憶及任務(wù)執(zhí)行等關(guān)鍵環(huán)節(jié)存在的安全隱患。研究團(tuán)隊(duì)通過梳理國際最新技術(shù)動(dòng)態(tài),系統(tǒng)歸納出智能體全生命周期中可能遭遇的12類風(fēng)險(xiǎn)場景,涵蓋數(shù)據(jù)泄露、算法偏見、決策失控等核心問題。針對這些風(fēng)險(xiǎn),白皮書創(chuàng)新性地提出"全層級-全周期"防護(hù)框架,明確劃分技術(shù)防護(hù)、管理管控、法律規(guī)制三層防御體系,并制定涵蓋數(shù)據(jù)加密、模型審計(jì)、應(yīng)急響應(yīng)等33項(xiàng)具體防控措施。

在實(shí)踐層面,白皮書詳細(xì)披露了中國電信與合作伙伴在金融、交通、醫(yī)療等領(lǐng)域的落地案例。例如在智能客服場景中,通過動(dòng)態(tài)身份核驗(yàn)與行為軌跡分析技術(shù),有效攔截了98.7%的異常操作請求;在自動(dòng)駕駛領(lǐng)域,建立的"感知-決策-執(zhí)行"三級驗(yàn)證機(jī)制,使系統(tǒng)容錯(cuò)率提升至99.99%。這些實(shí)踐為行業(yè)提供了可復(fù)制的安全治理模板。

參與編制的專家指出,AI智能體安全治理需要技術(shù)、管理、法律三方面協(xié)同推進(jìn)。清華大學(xué)團(tuán)隊(duì)提出的"可信增強(qiáng)學(xué)習(xí)"框架,通過在算法層嵌入安全約束模塊,使智能體在復(fù)雜環(huán)境中仍能保持合規(guī)決策;上海交通大學(xué)研發(fā)的"動(dòng)態(tài)風(fēng)險(xiǎn)評估引擎",可實(shí)時(shí)監(jiān)測智能體行為偏離度,及時(shí)觸發(fā)熔斷機(jī)制。這些技術(shù)突破為構(gòu)建安全可控的AI生態(tài)奠定基礎(chǔ)。

隨著智能體技術(shù)的快速發(fā)展,其安全治理已成為關(guān)乎數(shù)字社會(huì)穩(wěn)定的關(guān)鍵命題。中國電信表示,將持續(xù)深化與產(chǎn)學(xué)研用各方的合作,推動(dòng)建立智能體安全認(rèn)證體系,完善從芯片層到應(yīng)用層的全鏈條防護(hù)機(jī)制,為人工智能技術(shù)健康發(fā)展筑牢安全基石。