近日,科技圈內掀起了一場關于大型語言模型相似性的熱議風波。事件的起因是,一項在GitHub和arXiv平臺上發布的研究報告指出,華為推出的盤古大模型(Pangu Pro MoE)與阿里巴巴達摩院發布的通義千問Qwen-2.5 14B模型在參數結構上存在顯著的相似之處,這一發現迅速引發了業界的廣泛關注。

據詳細爆料,某研究團隊在名為HonestAGI/LLM-Fingerprint的GitHub項目中,對多個主流的大型語言模型進行了深入比對。他們驚人地發現,盤古Pangu Pro MoE與Qwen-2.5 14B模型在注意力模塊上的相似性極高,這一特征在其他模型的對比中并未出現。這一結果引發了業界對于盤古模型是否基于Qwen模型進行訓練或修改的質疑。

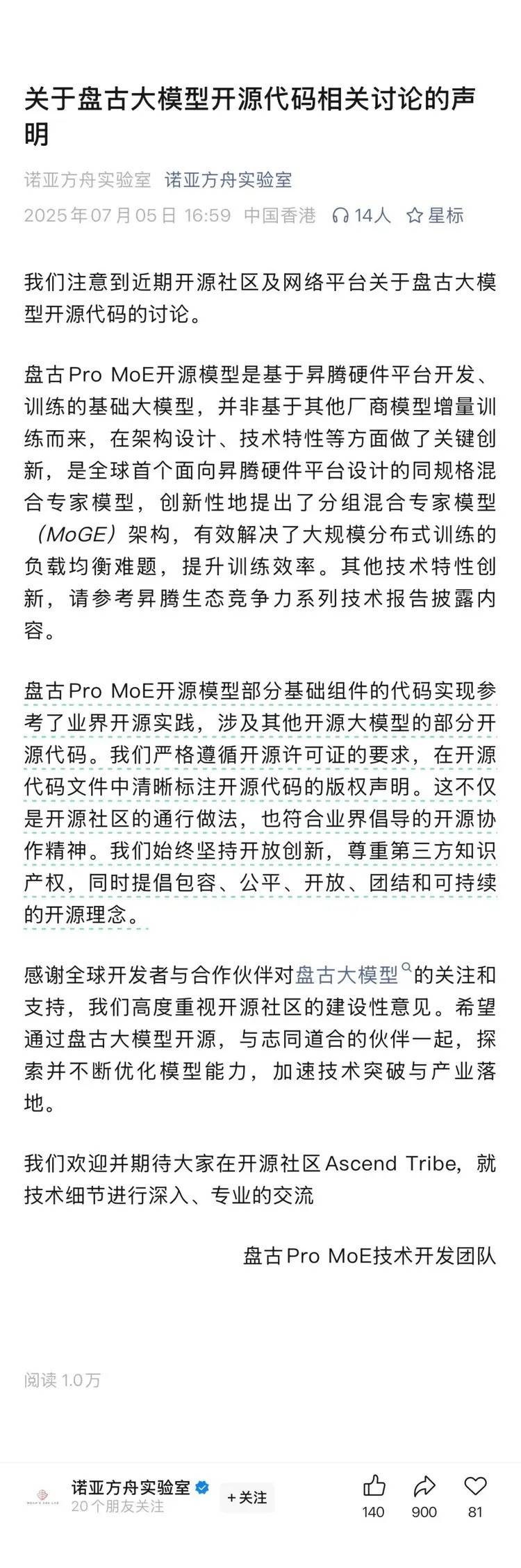

面對這一風波,華為盤古Pro MoE技術開發團隊迅速做出了回應。他們發表聲明稱,盤古Pro MoE開源模型的部分基礎組件代碼實現確實參考了業界的開源實踐,并涉及了其他開源大模型的部分代碼。但華為方面強調,他們嚴格遵循了開源許可證的要求,并在開源代碼文件中清晰標注了開源代碼的版權聲明。這一做法不僅符合開源社區的通行規則,也彰顯了業界倡導的開源協作精神。

華為團隊進一步表示,他們始終堅持開放創新的理念,尊重第三方的知識產權,并積極提倡包容、公平、開放、團結和可持續的開源理念。他們感謝全球開發者與合作伙伴對盤古大模型的關注和支持,并高度重視開源社區的建設性意見。華為希望通過盤古大模型的開源,與志同道合的伙伴一起探索并不斷優化模型能力,共同推動技術的突破與產業的落地。