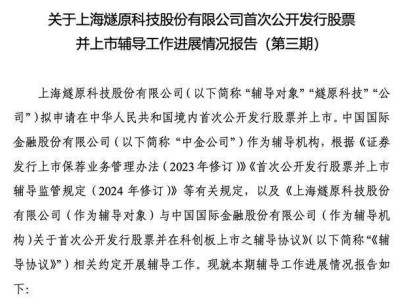

近日,阿里巴巴旗下的通義萬相團隊宣布了一項重大技術進展,正式開源了名為Wan2.1-VACE的視頻編輯與生成統一模型。這一創新成果在視頻處理領域引起了廣泛關注,被視為業界功能最為全面的視頻生成與編輯解決方案。

Wan2.1-VACE模型以其強大的多功能性著稱,能夠在一個單獨的模型架構內實現多種視頻處理任務。這包括從文本生成視頻、基于圖像參考的視頻生成、視頻重繪、局部編輯、背景延展以及時長延展等。更令人矚目的是,它還支持多任務組合生成,這意味著用戶可以在一個流程中完成多個復雜的視頻編輯操作。

該模型基于通義萬相V2.1平臺開發,提供了1.3B和14B兩種參數規模的版本以滿足不同需求。輕量級的1.3B版本能夠在消費級顯卡上流暢運行,支持480P視頻輸出;而14B的滿血版則支持更高的分辨率,包括480P和720P,并提供更優質的處理效果。開發者可以通過GitHub、Huggingface以及魔搭社區等平臺下載并體驗這一模型。

在實際應用中,Wan2.1-VACE展現出了極高的靈活性和實用性。例如,它可以將一幅豎版的《蒙娜麗莎》靜態圖像轉換為橫版動態視頻,并根據另一幅參考圖像為其添加眼鏡,這一過程同時完成了畫幅擴展、時長延展和圖像參考三項任務。這種能力不僅簡化了視頻創作的流程,還極大地拓寬了創意的邊界。

該模型的核心優勢在于其支持多任務靈活組合處理的能力。傳統上,完成類似的視頻編輯任務可能需要多個模型串聯工作,流程復雜且效率低下。而Wan2.1-VACE則通過單一模型實現了任意基礎能力的自由組合,用戶無需針對特定功能訓練新的專家模型,即可完成更復雜的任務。

Wan2.1-VACE在技術創新方面也取得了顯著突破。它引入了全新的視頻條件單元VCU,這一創新設計在輸入形態上統一了文生視頻、參考圖生視頻、視頻生視頻以及局部視頻生視頻四大類視頻生成和編輯任務。VCU將多模態的各類上下文輸入轉化為文本、幀序列和Mask序列三大形態,從而實現了多任務自由組合的技術基礎。

在解決多模態輸入難題方面,Wan2.1-VACE也展現出了其獨特的優勢。它將VCU輸入的幀序列進行概念解耦,分別重構為可變序列和不可變序列后進行編碼,從而有效解決了token序列化的問題。

隨著Wan2.1-VACE的開源,視頻生成技術正迎來從單任務向多任務組合邁進的重要階段。這一創新成果不僅為視頻創作者提供了更為便捷和高效的工具,也為視頻處理領域的未來發展開辟了新的道路。