在科技界的矚目之下,百度近期宣布了一項震撼業界的決定:正式向公眾開放其文心大模型4.5系列。這一舉動無疑在業內投下了一顆震撼彈,彰顯了百度在人工智能領域的深厚積累和開放姿態。

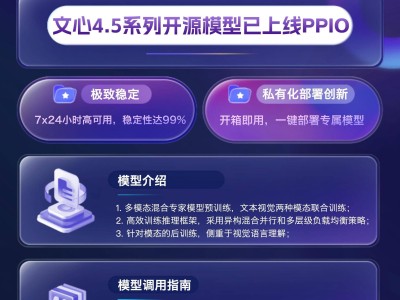

此番開源,百度慷慨地貢獻了包括47B、3B激活參數的混合專家(MoE)模型,以及0.3B參數的稠密型模型在內的10款模型。更令人驚喜的是,百度不僅開放了預訓練權重,連同推理代碼也一并奉上,這樣的誠意之舉無疑為開發者們提供了極大的便利。目前,這些模型已在飛槳星河社區、Hugging Face等平臺上線,百度智能云千帆大模型平臺也提供了相應的API服務,開發者們可以輕松下載并部署使用。

其實,早在今年年初,百度就已預告了文心大模型4.5系列的即將推出,并明確了6月30日的開源日期。盡管升級版文心大模型4.5 Turbo系列并未在此次開源名單中,但仍未阻擋開發者們的熱情與期待。

消息發布后,開發者社區反響熱烈。Reddit上的開發者紛紛點贊,認為小參數版本對于內存有限的配置來說是一大福音。有人甚至預測,300B參數的模型能與DeepSeek V3的671B模型一較高下,而21B參數的模型也不遜色于阿里的Qwen 30B。更有開發者驚喜地發現,28B模型在基礎文本能力之外,還增加了視覺功能,直呼“太酷了”。不過,大家最為期盼的還是文心大模型4.5 Turbo系列的開源,對高性能模型的渴望溢于言表。

文心大模型4.5自今年3月發布以來,便以其強大的實力贏得了廣泛關注。作為百度自研的新一代原生多模態基礎大模型,它在多個測試集上的表現甚至超越了GPT-4。尤其是在圖片理解方面,無論是照片、電影截圖、網絡梗圖、漫畫還是圖標,都能被文心大模型4.5輕松駕馭。同時,它還能精準捕捉音視頻中的場景、畫面、人物等特征,在生成名人、物品等方面更是栩栩如生。這些成就的背后,是百度飛槳深度學習框架的高效訓練、推理和部署,以及模型FLOPs利用率高達47%的驚人效率。

百度創始人李彥宏曾在文章中提到,原生多模態大模型是實現多模態數據原生級融合的關鍵,是邁向通用人工智能(AGI)的重要一步。文心大模型4.5系列無疑是對這一理念的完美詮釋。其背后的三大關鍵創新——多模態異構MoE預訓練、可擴展高效的基礎設施以及針對特定模態的后訓練,共同構成了其強大的技術支撐。

多模態異構MoE預訓練使得文心大模型4.5能夠基于文本和視覺模態聯合訓練,捕捉多模態信息的細微差別,從而提升各種任務的性能。而可擴展高效的基礎設施則通過異構混合并行、分層負載均衡策略等先進技術,實現了模型的高效訓練和推理。最后,針對特定模態的后訓練則滿足了實際應用的多樣化需求,使得文心大模型4.5在通用語言理解和生成、視覺語言理解等方面都表現出色。

對于百度此次開源的舉動,南加州大學計算機科學副教授、三星年度人工智能研究員Sean Ren給予了高度評價。他認為,大型實驗室開源強大模型將提高整個行業的標準,給閉源模型提供商帶來壓力。百度作為國內大模型研發的先行者之一,已經打造出了豐富的模型系列,并實現了日均調用量的顯著增長。Sean Ren還指出,雖然消費者可能不太關心模型代碼是否開源,但開源模型帶來的更低成本、更好性能以及對其語言或地區的支持等好處卻是顯而易見的。這將為開發人員和研究人員提供更加自由的迭代、定制和部署環境。

百度此次開源文心大模型4.5系列無疑將對國內乃至全球大模型產業的發展產生深遠影響。我們期待著這些開源模型能夠催生出更多創新應用,為人工智能領域注入新的活力。