百度近日正式向公眾開放了其最新的文心大模型4.5系列,這一動作早在今年2月就已預告。6月30日,包括混合專家(MoE)模型及稠密型模型在內的10款模型悉數亮相,且預訓練權重與推理代碼均實現完全開源。

此次開源的ERNIE 4.5系列模型,涵蓋了從47B到0.3B參數量的不同版本,均基于Apache License 2.0許可發布,允許商業使用但需遵循相關條款。百度還推出了配套的開發工具包ERNIEKit,集成了模型訓練、壓縮等多種功能,旨在為用戶提供一站式解決方案。

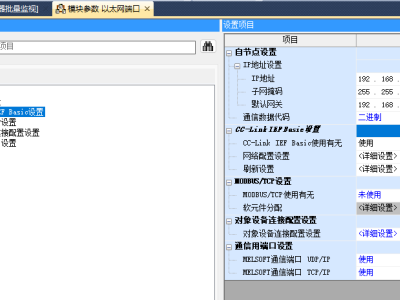

用戶現已可在飛槳星河社區、HuggingFace等平臺下載并部署文心大模型4.5系列,同時,百度智能云千帆大模型平臺也提供了相應的API服務。英特爾迅速響應,已實現對文心4.5系列端側模型的適配,并在其酷睿Ultra平臺上成功部署。

文心大模型4.5系列的創新之處體現在多個方面。首先,它采用了多模態混合專家模型預訓練技術,通過聯合文本和視覺兩種模態進行訓練,有效提升了模型在文本生成、圖像理解及多模態推理等任務中的表現。其次,為了支持高效訓練與推理,百度提出了異構混合并行、多層級負載均衡等策略,顯著提升了預訓練吞吐,并實現了接近無損的4-bit和2-bit量化。最后,針對實際場景的不同需求,百度對預訓練模型進行了針對模態的后訓練,優化了模型在通用語言理解、視覺語言理解等方面的性能。

在多項評測中,ERNIE 4.5系列模型展現出了卓越的性能。例如,在28個基準測試中,ERNIE-4.5-300B-A47B-Base在22個測試中超越了DeepSeek-V3-671B-A37B-Base,且在泛化能力、推理和知識密集型任務方面表現尤為突出。輕量級模型ERNIE-4.5-21B-A3B盡管參數量較少,但在多個數學和推理基準上效果優于Qwen3-30B-A3B-Base,實現了效果與效率的平衡。

在非思考模式下,ERNIE-4.5-VL在視覺感知、文檔與圖表理解等方面表現出色,而在思考模式下,它不僅展現出更強的推理能力,還保留了強大的感知能力。在各種多模態評估基準中,ERNIE-4.5-VL-424B-A47B均取得了優異效果,特別是在高難度基準上優勢明顯。

英特爾方面,其OpenVINO工具套件已對文心4.5的0.3B參數量稠密模型成功適配,并在酷睿Ultra平臺上獲得了優異的推理性能。這一合作不僅進一步豐富了OpenVINO的模型庫,也為開發者提供了更多選擇和更高效的AI開發工具鏈。