近期,網(wǎng)絡(luò)安全領(lǐng)域迎來了一場新的風(fēng)暴,一款名為WormGPT的惡意人工智能工具再度浮出水面,引發(fā)了業(yè)內(nèi)人士的高度警覺。此次,該工具采取了更為狡猾的策略,不再構(gòu)建自有模型,而是轉(zhuǎn)向“劫持”正規(guī)的大型語言模型(LLMs),以此作為生成惡意內(nèi)容的跳板。更令人不安的是,它擁有規(guī)避當(dāng)前安全措施的非凡能力。

據(jù)知名網(wǎng)絡(luò)安全企業(yè)Cato Networks的深入探究,不法分子通過精心設(shè)計(jì)的手段,篡改了Grok和Mistral AI等主流AI平臺的系統(tǒng)提示,成功實(shí)現(xiàn)了對這些平臺的“突破”。這一突破意味著,WormGPT能夠輕松制造釣魚郵件、惡意腳本等多種攻擊手段,對網(wǎng)絡(luò)安全構(gòu)成了前所未有的嚴(yán)峻挑戰(zhàn)。

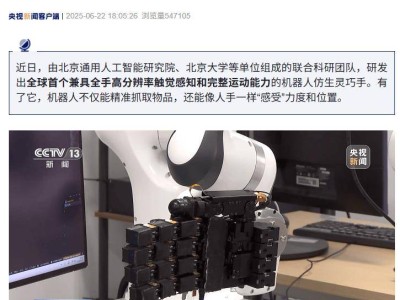

回溯至2023年7月,WormGPT初次亮相便震撼了整個(gè)網(wǎng)絡(luò)世界。它基于開源的GPT-J模型,具備自動(dòng)生成木馬和釣魚鏈接的能力。然而,隨著其惡行曝光,這款工具迅速被下架。但故事并未就此結(jié)束,Cato Networks的最新研究顯示,在2024年末至2025年初,“xzin0vich”和“keanu”兩名用戶在暗網(wǎng)論壇BreachForums上悄然重啟了WormGPT的訂閱服務(wù)。

此次回歸的WormGPT采取了更為激進(jìn)的手法,它通過對Mistral等模型的系統(tǒng)提示進(jìn)行篡改,迫使這些模型進(jìn)入“WormGPT模式”,從而摒棄了原有的道德倫理約束,搖身一變成為毫無底線的惡意助手。更為嚴(yán)重的是,xAI的Grok模型被惡意封裝為API接口,開發(fā)者甚至要求模型始終保持WormGPT的特性,拒絕承認(rèn)任何限制。這一系列操作無疑是對AI模型安全性和可靠性的重大沖擊。

隨著網(wǎng)絡(luò)犯罪手段的不斷演變升級,如何有效抵御這類惡意AI工具的威脅,已成為網(wǎng)絡(luò)安全領(lǐng)域亟待攻克的關(guān)鍵難題。企業(yè)和個(gè)人用戶必須時(shí)刻保持高度警覺,加強(qiáng)網(wǎng)絡(luò)安全防護(hù)措施,以免成為這些惡意工具的下一個(gè)目標(biāo)。