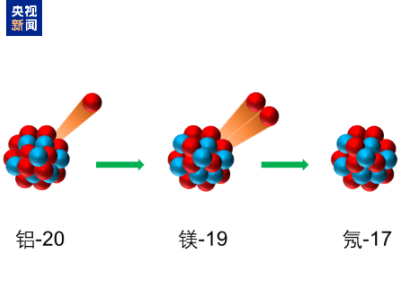

DeepMind,谷歌旗下的AI研究巨頭,近期推出了一款名為Gemini Robotics On-Device的創新模型,該模型融合了視覺、語言和行動(VLA)功能,專為在機器人硬件上本地運行而設計。這一突破性的進展意味著機器人能夠在無網絡或需要低延遲響應的場景中,高效執行復雜指令。

作為Gemini Robotics家族系列的最新成員,Gemini Robotics On-Device首次實現了模型的微調功能,僅需50次演示即可針對特定任務進行優化。這一特性大大提升了模型的靈活性和實用性,使其能夠迅速適應各種應用場景。DeepMind在雙臂Aloha機器人上對該模型進行了初步訓練,并在其他機器人平臺上進行了測試,結果顯示其在新硬件上的表現同樣出色。

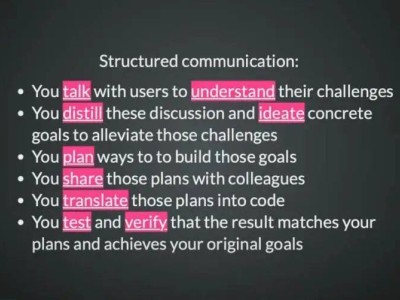

Gemini Robotics On-Device模型能夠遵循自然語言指令,并通過視覺感知環境中的對象,進行智能推理和執行操作。DeepMind表示,這一本地解決方案將有效解決機器人領域面臨的延遲和連接性挑戰,推動機器人技術的進一步創新。他們還推出了Gemini Robotics SDK,為開發者提供了根據特定需求調整模型的工具,進一步加速了機器人應用的開發進程。

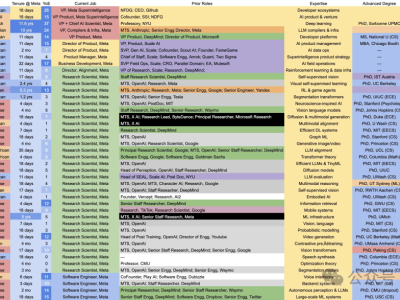

今年早些時候,DeepMind首次公開了Gemini Robotics家族系列。該系列基于谷歌的Gemini 2.0大型語言模型(LLMs),并增加了用于物理行動的輸出模態。為了評估機器人技術的安全性和視覺推理能力,DeepMind還發布了ASIMOV基準測試和具身推理問答(ERQA)評估數據集。這些基準測試為機器人技術的研究和應用提供了重要的參考標準。

在實驗中,DeepMind展示了Gemini Robotics模型快速適應新任務的能力。針對包括準備食物和玩牌在內的7種不同任務,他們對模型進行了最多100次的演示微調。結果顯示,使用Gemini Robotics模型的機器人成功完成任務的比例超過60%,超過了當前最佳的本地VLA模型。Gemini Robotics模型的離線版本表現更為出色,成功率接近80%。

在Hacker News的討論中,一位用戶對Gemini Robotics On-Device模型的前景表示樂觀。他認為,VLAs有望成為機器人技術的“ChatGPT時刻”,通過微調多模態LLMs,可以輸出特定指令序列來控制機器人。這位用戶還指出,雖然目前大多數關注點在機器人手臂的物體操縱上,但這種方法同樣適用于其他任務,如智能割草機等。

目前,Gemini Robotics On-Device模型尚未廣泛可用,但感興趣的開發者可以通過注冊等待名單獲取訪問權限。同時,Gemini Robotics-ER模型的互動演示已在網站上上線,供用戶體驗。Gemini Robotics SDK也已開源至GitHub平臺,供開發者下載和使用。

DeepMind的這一創新不僅為機器人技術帶來了革命性的突破,也為開發者提供了強大的工具,推動機器人應用在更多領域實現智能化和自動化。隨著技術的不斷進步和應用的不斷拓展,我們有理由相信,未來的機器人將更加智能、靈活和高效。